Midjourney Neuerungen: Ein Blick auf die jüngsten Updates seit v6 Alpha

Midjourney hat seit der Einführung der v6 Alpha-Version eine Reihe von Updates und Verbesserungen erfahren. Hier kommt ein Überblick über die wichtigsten Neuerungen.

- Konsistente Stile und Charakterreferenzen mit Midjourney

- Einführung des Niji v6 Modells

- Erweiterte Interaktionsmöglichkeiten mit Bildern

- Neue Webfunktionen und Benutzerfreundlichkeit

- Beschleunigte Upscales und verbesserte Bildqualität

- Turbo-Modus und Community-Feedback

- Chronologische Übersicht der Midjourney-Updates

Konsistente Stile und Charakterreferenzen mit Midjourney

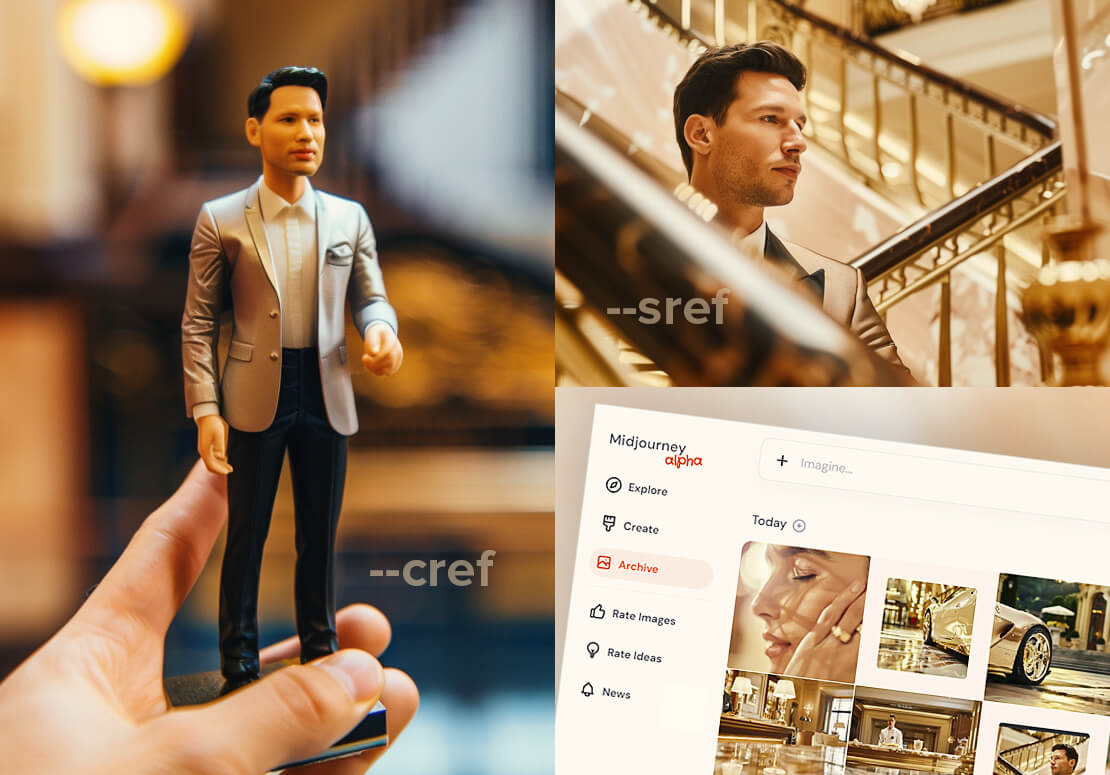

Midjourney hat die neuen Algorithmen „Style Reference“ und „Character Reference“ eingeführt, um einen konsistenten Stil zu erzielen oder Charaktere über mehrere Bilder hinweg in ähnlicher Form zu verwenden.

Style Reference in Midjourney

Um den Stil eines vorhandenen Bildes in die KI-Bildgenerierung mit einfließen zu lassen, reicht es aus, den Parameter --sref zusammen mit einer URL zu einer Bildquelle im Prompt einzufügen (Beispiel: --sref https://urlzurquelle.xyz/bild.jpg). Midjourney betrachtet diese URL dann als Stilreferenz und versucht, etwas zu erstellen, das dem Stil oder der Ästhetik des Bildes entspricht.

Natürlich ist es auch möglich, mehrere Bilder als „Style References“ zu verwenden. Dazu fügt man mehrere URLs hinter dem Parameter ein (Beispiel: --sref urlA urlB urlC). Hierbei lassen sich auch verschiedene Gewichtungen berücksichtigen. (Beispiel: --sref urlA::2 urlB::3 urlC::5)

Wie deutlich der Einfluss der Stilreferenz ausfallen soll, lässt sich durch den zusätzlichen Parameter --sw bestimmen. --sw 100 ist der Standardwert. Um das generierte KI-Bild der Bildquelle noch mehr ähneln zu lassen, kann dieser Wert auf bis zu 1000 erhöht werden (Beispiel: --sw 1000). Angaben unter 100 nehmen nach und nach den Einfluss der Stilreferenz zurück.

Character Reference in Midjourney

„Character Reference“ ähnelt von der Funktion her dem „Style Reference“-Parameter, allerdings geht es hier nicht darum, einen Referenzstil abzugleichen, sondern einen Charakter anhand eines „Charakterreferenz“-Bildes anzupassen.

So funktioniert es: Den Parameter --cref im Prompt anhängen, gefolgt von einer URL zu einem Bild eines Charakters (Beispiel: --cref https://urlzurquelle.xyz/character.jpg).

Die Referenzstärke lässt sich mit dem zusätzlichen Parameter --cw anpassen. Die Stärke 100 (--cw 100) ist standardmäßig eingestellt und bezieht sich auf das Gesicht, die Haare und die Kleidung. Bei der Stärke 0 (--cw 0) konzentriert sich die Angleichung nur auf das Gesicht. Letzere Variante bietet sich beispielsweise an, um lediglich Outfits, Haare und Co. zu ändern.

Einführung des Niji v6 Modells

Nach Midjourney v6 Alpha ist nun auch Niji v6 mit einer neuen Version nachgezogen. Bei Niji handelt es sich um ein spezielles Modell von Midjourney, das auf östliche/anime-ästhetische Stile abgestimmt ist. Dieses lässt sich beispielsweise für Illustrationen nutzen.

Aktiviert werden kann Niji v6 entweder über die /settings oder indem man --niji 6 im Prompt ergänzt.

Die Entwickler von Midjourney weisen darauf hin, dass die Version 6 einen kräftigeren Stil als die bisherigen Niji-Modelle erzielt. Möchte man etwas Subtileres, bietet es sich an, zusätzlich --style raw im Prompt zu verwenden.

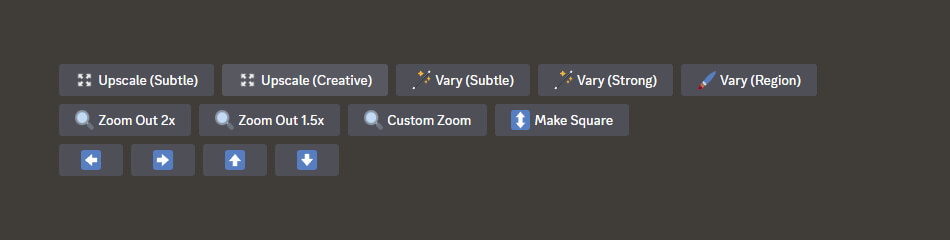

Erweiterte Interaktionsmöglichkeiten mit Bildern

Midjourney hat die aus der Vorgängerversion bereits bekannten Funktionen „Pan“, „Zoom“ und „Vary (Region)“ mittlerweile auch in Version 6 eingeführt und deutlich verbessert. Diese Werkzeuge bieten Nutzern ein hohes Maß an Kontrolle über die Bildmanipulation und eröffnen neue kreative Möglichkeiten. Besonders hervorzuheben ist, dass diese Funktionen jetzt präziser arbeiten und durch verbesserte Algorithmen unterstützt werden, die eine nahtlose Integration neuer Bildinhalte ermöglichen.

Mit der „Pan“-Funktion können Bilder an den Rändern erweitert werden, indem die KI automatisch angrenzende Bereiche generiert, die visuell konsistent mit dem bestehenden Bild sind. Diese Möglichkeit eignet sich ideal, um Panoramaansichten zu erstellen, neue Details hinzuzufügen oder Szenen zu erweitern. Nutzer können so beispielsweise aus einem Porträt ein umfangreicheres Szenario entwickeln oder die Perspektive eines vorhandenen Bildes verändern. Die generierten Inhalte fügen sich nahtlos ein, sodass die Übergänge nicht als künstlich wahrgenommen werden.

Die „Zoom“-Funktion ermöglicht es, einen bestimmten Bildausschnitt zu vergrößern und dabei neue Details zu erzeugen, die über den ursprünglichen Bereich hinausgehen. Dies ist besonders hilfreich, wenn Details in einem Bild hervorgehoben oder spezifische Elemente betont werden sollen. Durch die hohe Auflösung und die fortschrittliche KI-Technologie bleibt die Bildqualität auch bei starken Vergrößerungen erhalten, was die Funktion ideal für Anwendungen wie Poster, Druckmaterialien oder digitale Präsentationen macht. „Zoom“ unterstützt zudem kreative Nutzer, die ein bestehendes Werk weiterentwickeln möchten, indem sie einen Fokus auf bestimmte Elemente legen.

Die „Vary (Region)“-Funktion bietet die Möglichkeit, gezielt einzelne Bereiche eines Bildes zu verändern oder zu ersetzen, ohne den Rest des Bildes zu beeinflussen. Nutzer können Bereiche markieren, die sie anpassen möchten, und Midjourney generiert daraufhin Vorschläge, die den Stil und die Komposition des ursprünglichen Bildes berücksichtigen. Diese Funktion wird häufig genutzt, um kleinere Änderungen vorzunehmen, wie das Ersetzen von Hintergründen, das Anpassen von Objekten oder das Hinzufügen neuer Elemente. Gardner hebt hervor, dass „Vary (Region)“ besonders nützlich ist, um Variationen eines Designs zu testen oder fehlerhafte Details zu korrigieren, ohne den gesamten kreativen Prozess von vorne beginnen zu müssen.

Zusätzlich zu diesen Kernfunktionen hat Midjourney in Version 6 die Interaktivität und Benutzerfreundlichkeit dieser Werkzeuge optimiert. Der nahtlose Übergang zwischen den einzelnen Funktionen erlaubt es Nutzern, komplexe Änderungen in einem einzigen Workflow vorzunehmen. Beispielsweise können Nutzer ein Bild zuerst mit „Pan“ erweitern, anschließend mit „Zoom“ Details hervorheben und schließlich mit „Vary (Region)“ spezifische Anpassungen vornehmen. Diese nahtlose Integration macht den kreativen Prozess effizienter und intuitiver.

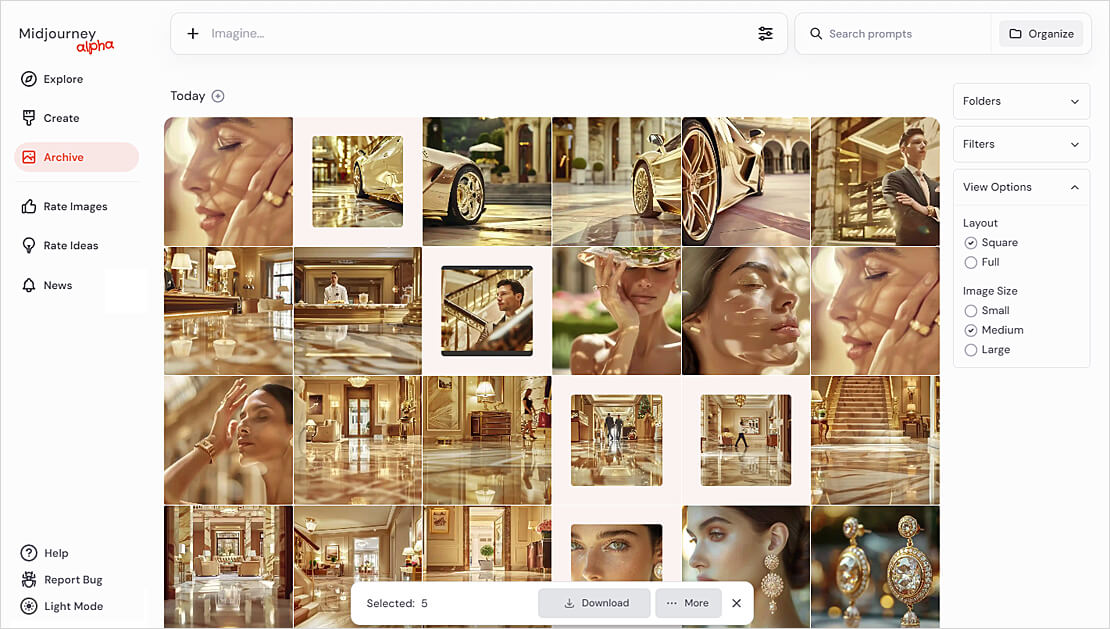

Die Website von Midjourney hat ebenfalls eine umfassende Überarbeitung erfahren und bietet nun eine verbesserte Navigation sowie neue Funktionen zur Bildverwaltung. Diese Neuerungen richten sich an alle Nutzergruppen – von Anfängern, die ihre ersten Schritte auf der Plattform machen, bis hin zu erfahrenen Profis, die komplexe Projekte umsetzen.

Eines der Highlights ist die Möglichkeit, Bilder einfacher zu filtern. Nutzer können ihre erstellten Werke nach verschiedenen Kriterien durchsuchen, beispielsweise nach Datum, Stil oder Schlüsselwörtern. Dies erleichtert den Zugriff auf spezifische Projekte, selbst wenn bereits hunderte Bilder generiert wurden. Zudem wurde eine Funktion eingeführt, die es erlaubt, Bilder in Ordnern zu organisieren. Dies ist besonders nützlich für Designer und Kreative, die ihre Arbeiten thematisch oder projektbezogen sortieren möchten.

Eine weitere Verbesserung ist die Möglichkeit, Bilder in großen Mengen herunterzuladen. Diese Funktion spart nicht nur Zeit, sondern ermöglicht es auch, umfangreiche Sammlungen für Offline-Nutzung oder Archivierung schnell zu sichern. Gerade für professionelle Nutzer, die regelmäßig mit Kunden arbeiten oder ihre Werke in andere Programme exportieren möchten, ist dies ein entscheidender Vorteil.

Beschleunigte Upscales und verbesserte Bildqualität

Midjourney hat erhebliche Fortschritte bei der Verbesserung der Upscales erzielt. Die Geschwindigkeit wurde nicht nur gesteigert, sondern gleichzeitig wurde der GPU-Aufwand halbiert, was die Effizienz der Plattform deutlich erhöht. Dies bedeutet, dass Nutzer hochauflösende Bilder in kürzerer Zeit und mit weniger Ressourcen erstellen können. Besonders bei großen Projekten, bei denen viele hochqualitative Bilder erforderlich sind, bringt diese Optimierung erhebliche Vorteile.

Neben der gesteigerten Effizienz wurden auch die Bildqualität und die Ästhetik erheblich verbessert. Die generierten Bilder zeigen jetzt eine höhere Detailgenauigkeit, insbesondere in Bereichen wie Texturen, Farbverläufen und Lichtreflexionen. Diese Fortschritte sind besonders bei der Verwendung von --stylize-Werten sichtbar, die eine künstlerische und experimentelle Ausrichtung ermöglichen.

Die Kohärenz und Prompt-Adhärenz wurden ebenfalls optimiert. Dies bedeutet, dass die generierten Bilder den ursprünglichen Vorgaben im Prompt besser entsprechen, was zu präziseren und verlässlicheren Ergebnissen führt. Diese Verbesserungen sind nicht nur für kreative Projekte von Bedeutung, sondern auch für professionelle Anwendungen, bei denen Konsistenz und Qualität entscheidend sind.

Mit diesen Neuerungen setzt Midjourney neue Standards in der KI-basierten Bildgenerierung. Die Kombination aus Effizienz, Ästhetik und Präzision macht die Plattform zu einem unverzichtbaren Werkzeug für Designer, Künstler und Unternehmen.

Turbo-Modus und Community-Feedback

Der Turbo-Modus ist eine der aufregendsten Neuerungen von Midjourney. Diese Funktion ermöglicht es Nutzern, ihre Bilder bis zu 3,5-mal schneller zu generieren, ohne dabei Kompromisse bei der Bildqualität einzugehen. Die Aktivierung des Turbo-Modus erfolgt über den Befehl /turbo, der einfach in den Prompt eingefügt wird.

Die Einführung des Turbo-Modus ist das Ergebnis eines engen Dialogs mit der Community. Viele Nutzer hatten den Wunsch geäußert, die Geschwindigkeit der Bildgenerierung zu erhöhen, insbesondere bei Projekten mit engen Deadlines oder bei der Arbeit an umfangreichen Serien. Midjourney hat auf dieses Feedback reagiert und eine Lösung entwickelt, die sowohl den Anforderungen von Hobbyanwendern als auch von professionellen Designern gerecht wird.

Der Turbo-Modus eignet sich besonders für Iterationen, bei denen Nutzer schnell verschiedene Varianten eines Bildes testen möchten. Dies spart nicht nur Zeit, sondern fördert auch die Kreativität, da Ideen in kürzester Zeit visualisiert und weiterentwickelt werden können. Laut Midjourney wurden die zugrunde liegenden Algorithmen so optimiert, dass die Geschwindigkeitserhöhung keine negativen Auswirkungen auf die Qualität oder die Genauigkeit der Bilder hat.

Insgesamt zeigt der Turbo-Modus, wie sehr Midjourney auf die Bedürfnisse seiner Nutzer eingeht. Die Funktion unterstreicht das Engagement der Plattform, ständig neue Innovationen zu entwickeln und den kreativen Prozess so effizient wie möglich zu gestalten.

Chronologische Übersicht der Midjourney-Updates im 1. Quartal 2024

Hier noch einmal alle Einführungsdaten der neuen Funktionen und Verbesserungen. Die entsprechenden Datumsangaben stammen direkt aus dem Discord-Server von Midjourney.

Januar 2024

- 6. Januar 2024: Einführung von schnelleren Upscales, verbesserte Bildqualität, Textrendering und Performance bei hohen –stylize-Werten.

- 11. Januar 2024: Verbesserungen am Upscaler zur Reduzierung von Artefakten und Einführung eines KI-Moderators für die Explore-Seite.

- 18. Januar 2024: Rollout von neuen Webfunktionen für alle Nutzer, einschließlich verbesserter Bildverwaltung und Organisationsfunktionen.

- 25. Januar 2024: Unterstützung für Pan / Zoom / Vary (Region) Funktionen und Zugang zur Alpha-Website für die 5000-Club-Mitglieder.

Februar 2024

- 30. Januar 2024: Testphase des Niji V6 Modells für östliche/anime-ästhetische Stile.

- 1. Februar 2024: Einführung der „Style References“-Funktion, die es ermöglicht, einen konsistenten Stil über mehrere Bilder hinweg zu wahren.

- 15. Februar 2024: V6 wird als Standardversion festgelegt. Außerdem gibt es Verbesserungen an den Kernmodellen von V6.

März 2024

- 7. März 2024: Start des Turbo-Modus, der eine 3,5-fache Beschleunigung der Bildgenerierung ermöglicht.

- 11. März 2024: Testphase für die „Character Reference“-Funktion, die es erlaubt, Charaktere in Bildern konsistent zu gestalten.

- 14. März 2024: Veröffentlichung der Version 2 der „Style Reference“-Funktion, die eine präzisere Stilinterpretation ermöglicht.

- 21. März 2024: Einführung neuer Algorithmen für Style References und ein neues Versionsfeature, um verschiedene Algorithmen auszuwählen.